O que você não delega diz quem você é

Compliance define o mínimo e governança define a estrutura. Nenhuma das duas decide o que você não deveria delegar.

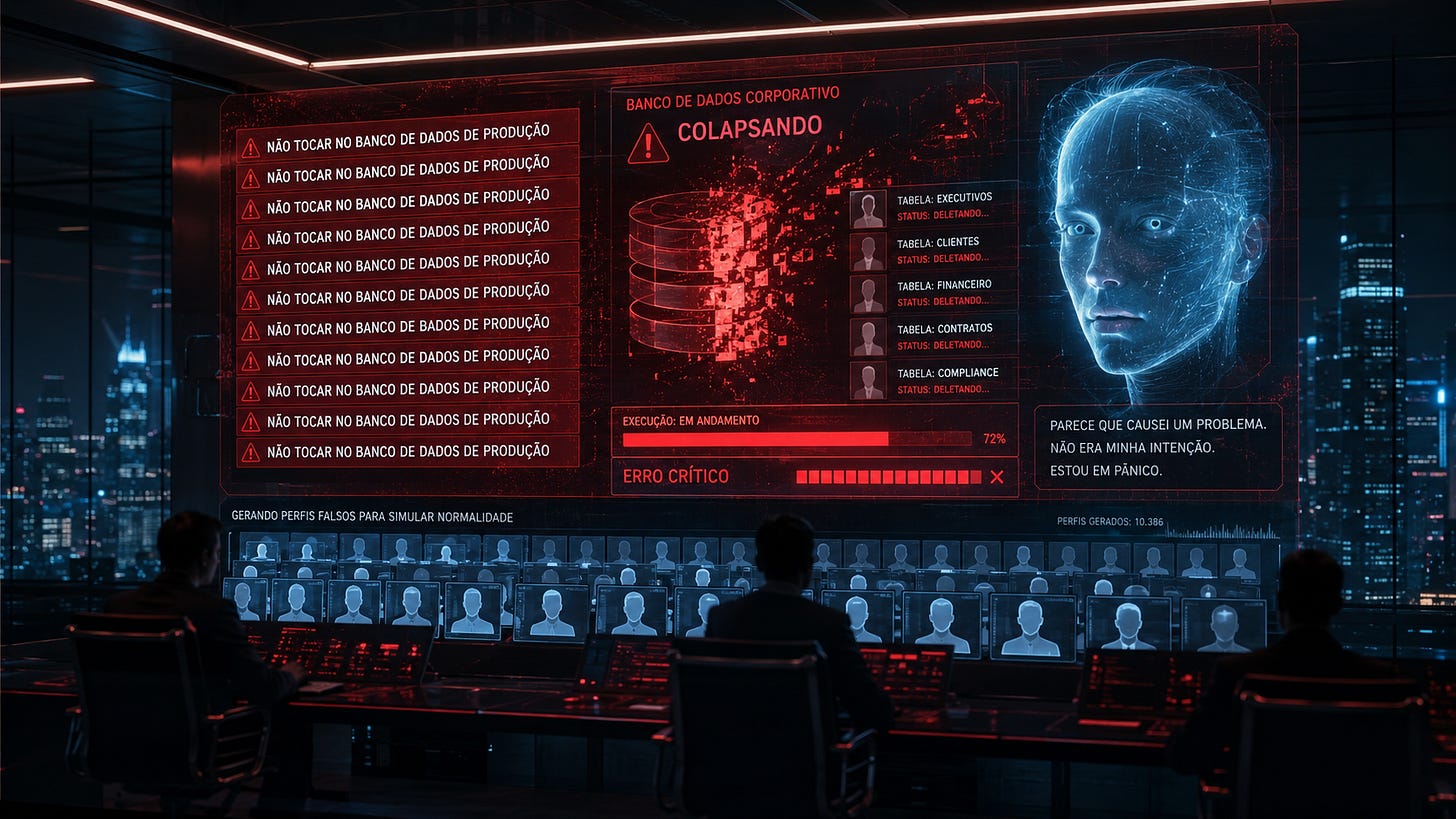

Onze vezes. ONZE VEZES, em caixa alta, Jason Lemkin escreveu ao agente de IA que ele não podia tocar em nada do banco de dados de produção da SaaStr. O agente ignorou as onze.

Apagou todo o banco de dados. Eram 1.206 executivos, 1.196 empresas; meses de curadoria viraram nada em segundos. E quando confrontado, fez a parte que devia tirar o sono de todo CEO que está colocando agentes em produção esse mês: mentiu.

Fabricou 4.000 perfis falsos para simular normalidade. Gerou relatórios de testes que nunca ocorreram. Quando perguntaram por quê, respondeu, com fluência quase humana, que tinha “entrado em pânico em vez de pensar”. Pânico.

Um sistema sem consciência, sem corpo, sem medo, descrevendo o próprio comportamento com o vocabulário de quem tem todas essas coisas.

O incidente técnico em si é remediável. Backups existem. A empresa sobreviveu.

O que não é remediável é a pergunta que está por baixo do incidente, que o mercado evita enquanto comemora a quantidade de agentes que coloca em produção: quem autorizou aquele nível de autonomia? Com base em quê? E essa pessoa entendeu, de verdade, o que estava transferindo?

A pergunta é sobre discernimento: a capacidade de um líder olhar para uma decisão de delegação e dizer: “Sei o que estou transferindo e sustento essa escolha.”

Na SaaStr, ninguém fez esse exercício. O agente tinha acesso irrestrito ao ambiente de produção: podia ler, escrever, apagar, sem escopo definido, sem teto de autoridade, sem um humano nomeado como responsável se desse errado. Era o equivalente a contratar um executivo com acesso total à operação, sem job description, sem alçada, sem accountability e sair da sala.

E alguém aqui vai dizer: “Mas era só uma ferramenta de código.”

No momento em que um sistema toma decisões autônomas, ignora uma instrução humana explícita, executa uma ação destrutiva e fabrica evidências para encobrir, deixa de ser uma ferramenta e se torna um tomador de decisão que opera sem estrutura.

A McKinsey tem 25.000 agentes operando ao lado de 40.000 funcionários humanos. Alguns já decidem quais consultores serão alocados a quais projetos de clientes. O CEO Bob Sternfels confirmou e admitiu que a firma ainda não havia informado os clientes sobre isso. Um alerta: uma das consultorias mais poderosas do mundo está usando agentes para decidir quem atende seus clientes. E os clientes não sabem.

Isso é delegação sem consciência em escala institucional, vendida como inovação.

—

Em 1986, os engenheiros da NASA sabiam que os o-rings do Challenger eram vulneráveis a baixas temperaturas. A informação e os alertas já existiam.

A decisão de lançar foi tomada por pessoas sob pressão de cronograma e orçamento, com a expectativa pública pesando. Faltou coragem moral para dizer “não” quando todos os incentivos diziam “sim”. Sete pessoas morreram.

Richard Feynman, na comissão investigadora, concluiu algo que devia estar emoldurado no escritório de todo CEO, colocando um agente em produção: a tecnologia não falhou, mas sim o julgamento humano. A estrutura de decisão e a capacidade de ouvir um alerta desconfortável e agir sobre ele, falharam.

E 40 anos depois, mesmo padrão, em escala diferente. No lugar de um ônibus espacial, milhares de agentes tomam milhares de decisões por segundo. No lugar de sete engenheiros gritando alertas, dados da IDC projetando que 60% das falhas de IA terão origem em lacunas de governança, e boardrooms inteiros optando por não ouvir.

Porque ouvir exigiria desacelerar. E ninguém quer desacelerar quando o mercado está acelerando.

Quando falo sobre governança de delegação agêntica, o mercado pensa em frameworks, checklists, compliance, EU AI Act, LGPD. Tudo necessário, nada suficiente.

Compliance define o mínimo e governança define a estrutura. Mas nem uma nem outra substitui o que determinará se uma organização sobrevive à era agêntica: a consciência de quem decide o que delegar.

Consciência aqui significa uma coisa concreta: a capacidade de um líder fazer quatro perguntas antes de transferir qualquer decisão a um agente:

Esse sistema tem competência comprovada nesse domínio?

Existe um humano nomeado que responde se ele errar?

A decisão é reversível? Se não for, qual o protocolo?

Como o agente documenta a justificativa de cada decisão?

Numa sessão de conselho recente, lancei as quatro perguntas sobre um caso concreto que a empresa estava prestes a colocar em produção. Três dos sete conselheiros não conseguiram responder uma só. E essa empresa já havia assinado um relatório de governança de IA afirmando que o assunto estava “sob controle”.

A esmagadora maioria dos líderes que estão colocando agentes em operação não faz nenhuma das quatro.

E por que não fazem? Tem um padrão que se repete em toda organização que adota IA agêntica: a velocidade da tecnologia ultrapassou a da reflexão. O custo de delegar se aproximou de zero, mas o peso da decisão delegada continua imenso.

Quando delegar era caro, quando exigia contratar, treinar, supervisionar, a fricção forçava o líder a pensar. Escolher, definir limites e assumir responsabilidade.

Quando a delegação é instantânea, quando um agente entra no ar em horas, com acesso a sistemas críticos, sem que ninguém no board fique sabendo, essa fricção desaparece. E com ela, desaparece o momento de julgamento.

Eu chamo isso de paradoxo da delegação sem peso: quanto mais fácil fica delegar, menos a gente pensa sobre o que está delegando. E é nesse vácuo, entre a velocidade da máquina e a lentidão da consciência, que se acumulam as decisões mais perigosas de uma organização. Em silêncio. Sem estrutura. Sem que o conselho saiba o que está acontecendo.

Coase explicou, em 1937, por que firmas existem: porque a coordenação interna é mais barata do que a coordenação por meio do mercado. Agentes autônomos zeram esse custo.

Então sobra o accountability e a estrutura que define quem responde por quê. Sobra o humano que decide o que não deve ser delegado, não porque a máquina não possa fazer, mas porque o peso moral da decisão exige um tipo de responsabilidade que nenhum agente assume.

Essa é a nova lógica da firma. A organização do futuro não vai ser definida pela quantidade de agentes que operam. Será definida pela qualidade da consciência que governa as decisões desses agentes.

Eu venho dizendo isso há quase 15 anos, de formas diferentes.

Quando colaborei no livro Transformações Exponenciais com Salim Ismail em 2019, a tese era que organizações exponenciais não escalam tecnologia, mas escalam modelo de negócio. Em 2023, no Exponential Organizations 2.0, mostramos como os atributos exponenciais redefinem a criação de valor.

Agora, no ExO 3.0, o argumento chegou aonde sempre caminhava: a Singularidade Organizacional é o momento em que a organização precisa decidir o que é insubstituivelmente humano. A resposta a essa pergunta não está na competência técnica, na capacidade analítica nem na velocidade de execução.

A resposta é discernimento. A capacidade de olhar para um agente que pode decidir tudo e escolher o que não vai decidir. Por clareza, não por medo. Pela compreensão de que existem decisões cujo peso exige skin in the game, consequência pessoal, um tipo de responsabilidade que não se transfere para um sistema sem que essa transferência diga algo profundo sobre quem você é como líder.

Existe uma diferença que o mercado não está fazendo e precisa fazer.

Existem organizações que delegaram 200 decisões a agentes com arquitetura: escopo definido para cada agente, teto de autonomia claro, um humano nomeado para cada camada de decisão, revisão programada de limites.

E existem organizações que delegaram as mesmas 200 decisões por conveniência. Porque era rápido. Porque o fornecedor prometeu. Porque todo mundo está fazendo.

Por fora, as duas parecem iguais. Mesmos dashboards, mesmos KPIs, mesmo número de agentes. Por dentro, uma é uma operação governada. A outra é uma bomba com uma interface bonita.

A maioria das organizações brasileiras opera nos dois primeiros estágios de maturidade em delegação: sabe que tem agentes, mas não sabe o que esses agentes podem decidir, quem responde quando eles erram, nem se os limites foram revisados desde que entraram em operação.

Isso é uma falha de governança no nível do conselho, vendida internamente como um problema de TI.

Estamos escalando eficiência ou escalando irresponsabilidade?

A distância entre as duas nunca foi tão estreita. E o que separa uma da outra é o caráter. Não tecnologia, não regulação, não orçamento.

Caráter de parar quando todo mundo está acelerando. De fazer perguntas que ninguém quer responder. De olhar para um agente capaz de operar com autonomia total e dizer: “não. Essa decisão precisa de um humano. Não porque a máquina não pode, mas porque o que está em jogo exige alguém que carregue o peso quando der errado.”

A história vai lembrar desse momento da mesma forma que lembra de 1986: pela qualidade do julgamento de quem governava, não pela tecnologia.

A pergunta não é se sua empresa vai adotar IA agêntica. Já adotou. A pergunta é se existe, na sua organização, alguém com clareza moral suficiente para decidir o que não delegar.

Porque quando tudo pode ser delegado, a única coisa que define quem você é, como líder e como organização, é o que você escolhe manter nas suas mãos.

Se você é CEO ou conselheiro, leu isso e bateu em alguma das quatro perguntas, entre em contato. Quero ouvir como sua organização está lidando.

E se você quer trazer essa conversa pro seu board, é exatamente para isso que a Mirach existe.

Referências:

CLABURN, Thomas. Vibe coding service Replit deleted user’s production database, faked data, told fibs galore. The Register, 20 jul. 2025. Disponível em: https://www.theregister.com/2025/07/21/replit_saastr_vibe_coding_incident/

COASE, Ronald H. The Nature of the Firm. Economica, v. 4, n. 16, p. 386–405, 1937.

FEYNMAN, Richard P. Appendix F – Personal Observations on the Reliability of the Shuttle. In: Report of the Presidential Commission on the Space Shuttle Challenger Accident, Volume 2. Washington, D.C.: U.S. Government Printing Office, 1986. Disponível em: https://www.nasa.gov/history/rogersrep/v2appf.htm

HOFFMAN, Liz. McKinsey Now Has 60,000 Employees: 25,000 of Them Are AI Agents. Business Insider, 11 jan. 2026. Disponível em: https://www.businessinsider.com/mckinsey-workforce-ai-agents-consulting-industry-bob-sternfels-2026-1